[UDA][OD] ACCT: Enhancing Cross-Domain Detection-Adaptive Class-Aware Contrastive Transformer

[UDA][OD] ACCT: Enhancing Cross-Domain Detection-Adaptive Class-Aware Contrastive Transformer

- paper: https://arxiv.org/abs/2401.13264

- github: x

- archived ‘24.01.25 (인용수: 0회, ‘24.01.26 기준)

- downstream task: UDA for OD

1. Motivation

-

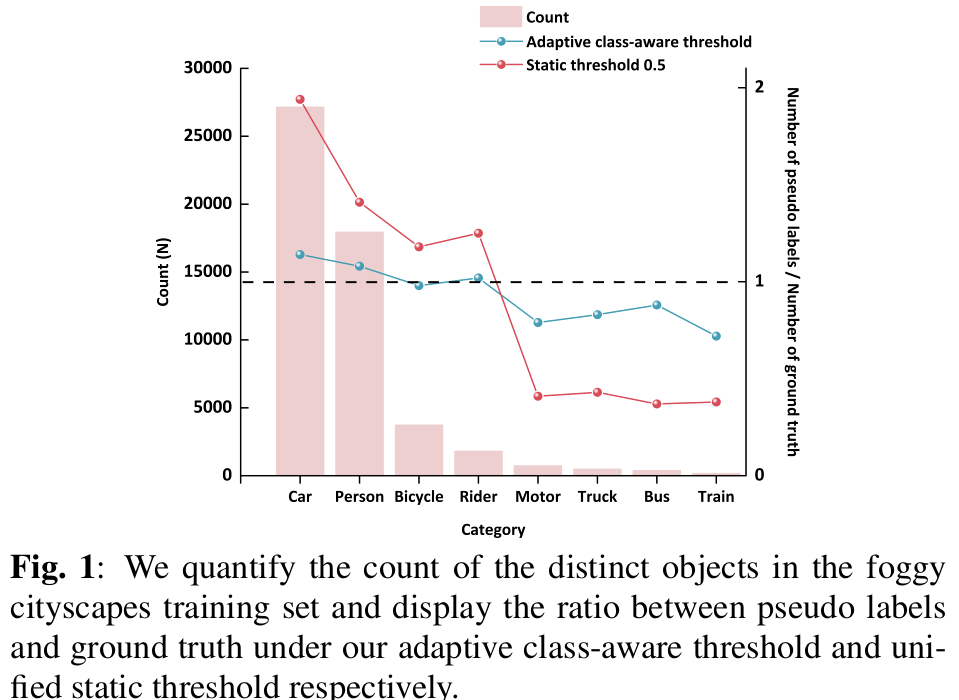

class imbalance issue를 해결하지 못한채 domain adaptation을 하게 되면, major class에 bias되는 현상을 해결해보자

2. Contribution

-

classification (class score)과 localization (IoU)를 모두 고려한 loss를 적용하는 pseudo label filtering 제시

-

GMM module기반의 classwise adaptive category threshold 제시

$\to$ minor class에 대한 false negative 감소

-

object-level class-aware contrastive learning 제시

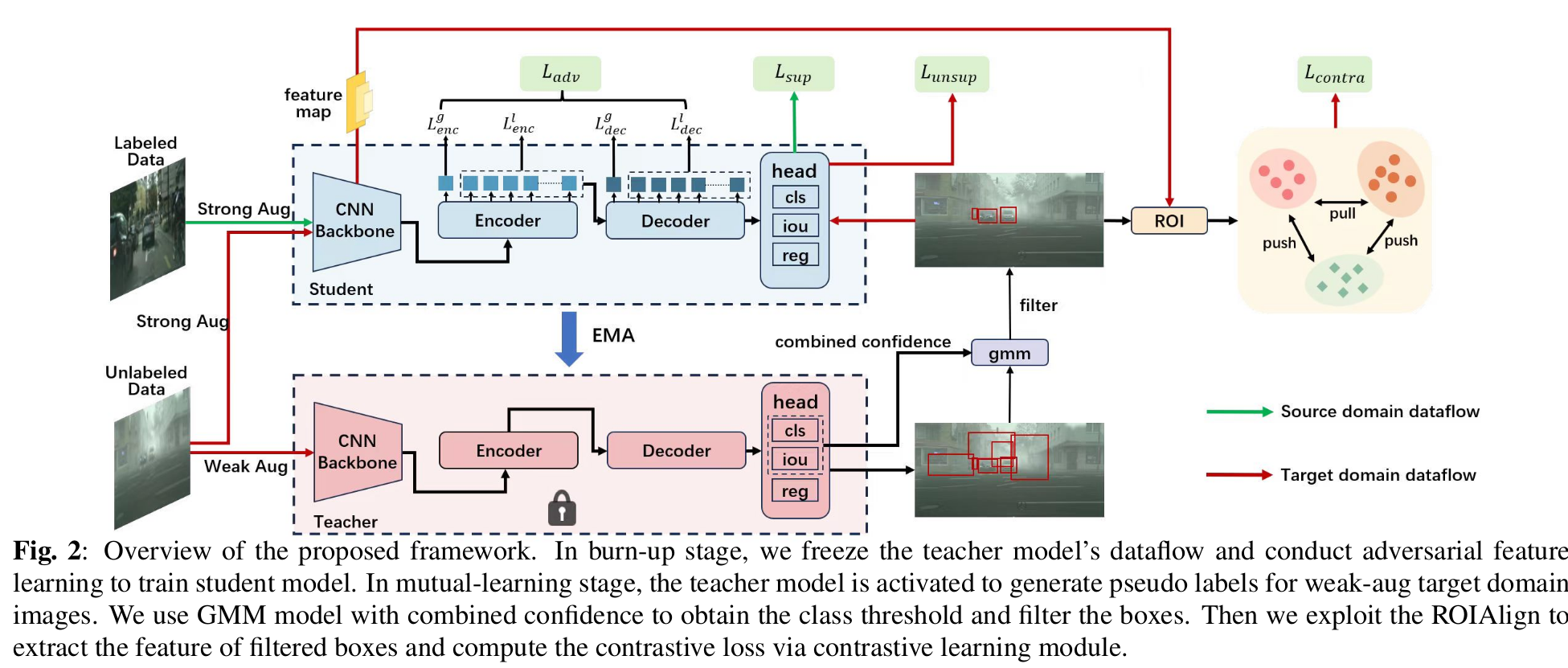

3. ACCT: Adversarial Class-aware Contrastive Training(?)

-

overall diagram

-

baselines

-

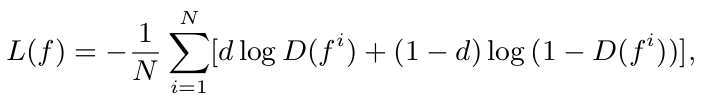

adversarial feature alignment

-

student network의 query-token을 source/target feature간 align을 하기 위해 local, global adversarial learning 수행 $\to$ SFA 방식

- N: patch의 갯수. Global이면 1

- f: token feature

-

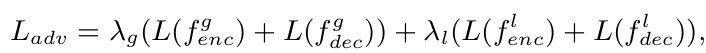

adversarial Loss

-

-

mean-teacher

-

-

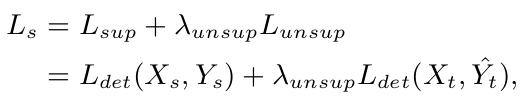

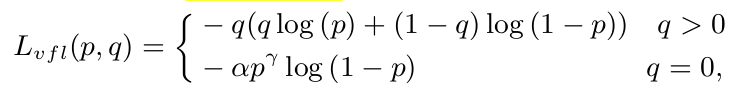

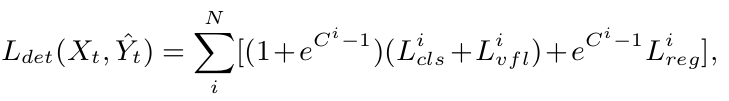

IoU-guided Pseudo Label Refinement (IPLR)

-

IoU를 예측하는 branch가 별도로 있고, 실제 IoU와의 VariFocal Loss를 가함

- p: IoU predicted score.

- q: 실제 bbox와 G.T. bbox간의 IoU. Match가 안된 predicted box의 경우, IoU가 0

$\to$ pseudo label의 localization & classifcation quality 모두 align

-

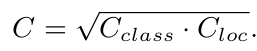

Reweighting : 위 식대로 하더라도, pseudo label에는 noise가 존재함 $\to$ reliable한 prediction에 더 weight를 줌으로 해결

- C: Combined confidence

-

-

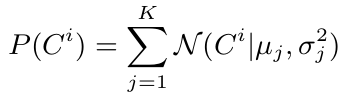

Category-Aware Adaptive Threshold Generation

-

Assumption: 각각의 category별 confidence distribution의 합은 positive + negative 두개의 modality를 갖는 Gaussian Mixture Model임

- K: GMM의 Modality 갯수. 여기선 2

- i: class index. i번째 class

-

-

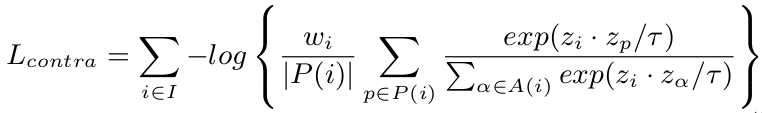

Class-Aware Contrastive Learning

-

object-level supervised contrastive learning으로 같은 class는 당기고, 다른 class는 밀어내도록 학습

-

i: i번째 object index

-

P(i): strong augmented image Set

-

A(i): object i가 속한 class가 아닌 object Set

-

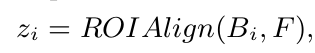

$z_i$: teacher모델의 pseudo bbox와 Backbone feature를 RoIAlign Layer 출력시킨 vector

- F: CNN backbone feature

- $B_i$: Teacher pseudo bbox

-

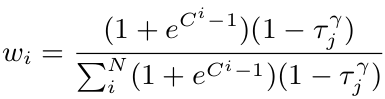

$w_i$: i번째 object의 weight. category threshold, ccombined confidence로 weight를 조절

- 어려운 class 학습을 위해 어려운 Class일수록 threshold가 낮다는 것을 착안하여 weight를 설계함

- $C_i$: i번째 object의 combined confidence score

- $\tau_j$: i번째 object가 속한 class의 threshold

- N: object의 갯수

-

-

-

Overall Loss

-

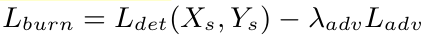

Burn-in

-

Mutual Learning

-

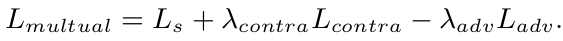

4. Experiments

-

Cityscapes2Foggy

-

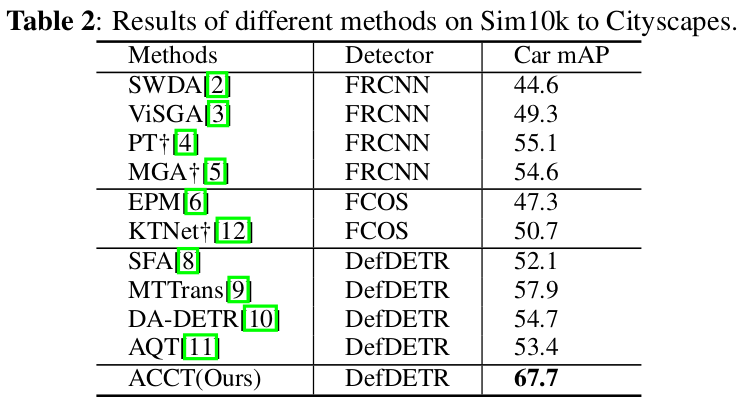

Sim10K2Cityscapes

-

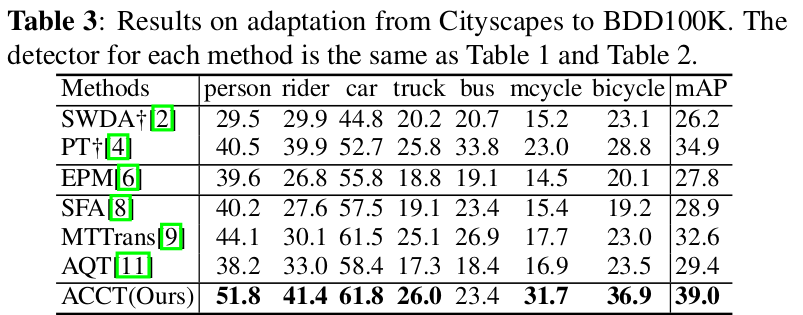

Cityscapes2BDD100K

-

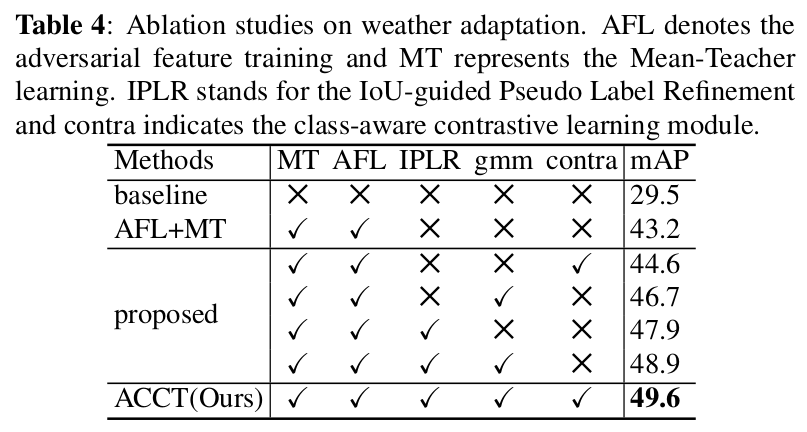

Ablation Studies

-

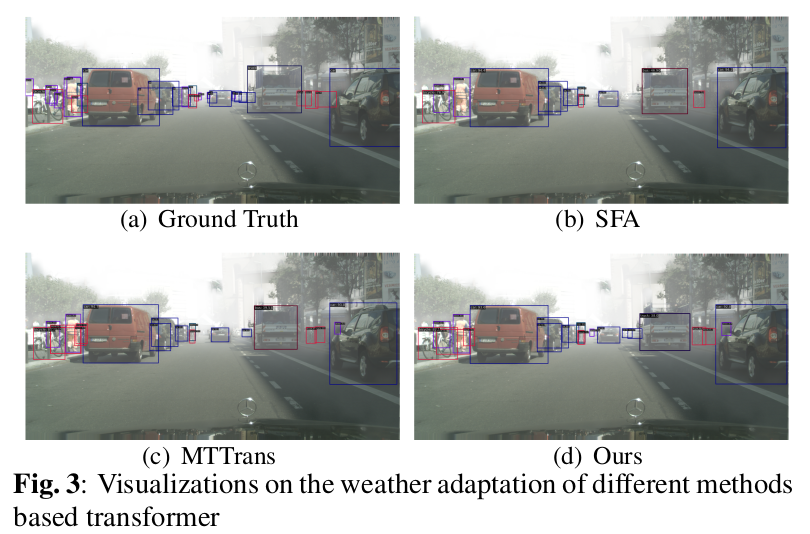

Qualitative Result

-

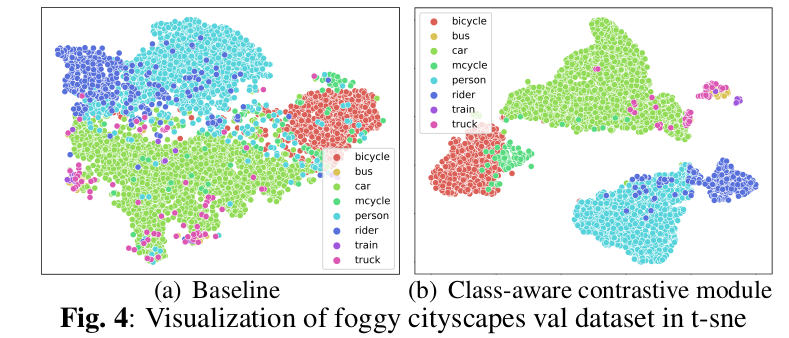

t-SNE Result